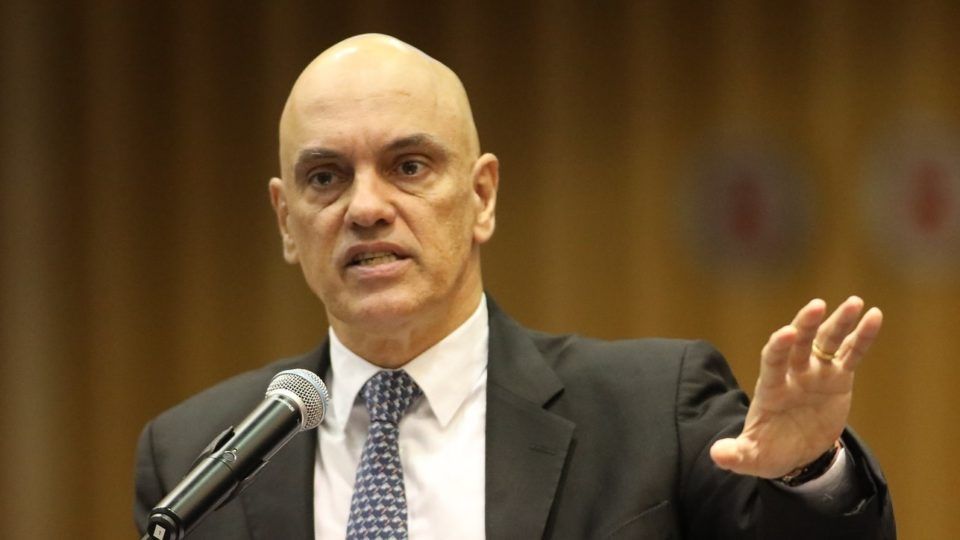

O ministro do Supremo Tribunal Federal (STF) Alexandre de Moraes não poderia ter deixado mais claro. Ele criou uma metáfora para explicar, nesta quinta-feira (25), durante evento em Londres, na Inglaterra, porque as grandes empresas de tecnologia, conhecidas como bigh techs, devem ser responsabilizadas pela circulação de conteúdos antidemocráticos que circulam por elas.

Ele ressaltou ainda a necessidade do combate ao que ele chama de "mercado livre de ódio e fascismo".

Te podría interesar

Durante palestra no 1º Fórum Jurídico Brasil de Ideias, evento organizado pelo site Consultor Jurídico (Conjur) que também reuniu os ministros Gilmar Mendes e Dias Toffoli entre outras autoridades, Moraes comparou as bigh techs ao comércio ilegal de cocaína.

Segundo ele, as bigh techs devem ser responsabilizadas pelos conteúdos criminosos que circulam em suas plataformas porque são monetizadas e têm lucros.

Te podría interesar

"As big techs dizem exatamente isso: que elas são grandes depósitos. Não há nenhum problema. Se você tem um depósito na vida real, você aluga o depósito e a pessoa que alugou faz de lá um laboratório de cocaína, você não tem responsabilidade por isso, você não sabia", afirmou.

"Agora, se você descobre e faz um aditamento no contrato para ganhar 10% da venda da cocaína, no mundo real você tem que ser responsabilizado. Disso, ninguém discorda", seguiu.

No entanto, ressaltou o ministro, "no mundo virtual, se você simplesmente é um depositário de artigos, vídeos, você não pode ser responsabilizado. Agora, se você monetiza isso, se você coloca os seus algoritmos para direcionar com prioridade essas notícias, aí você está igual à pessoa que está ganhando 10% da cocaína", ressaltou.

Pedofilia e pornografia infantil

Moraes disse ainda que as redes já contam com vários mecanismos para impedir a circulação de conteúdos que envolvam pedofilia e pornografia infantil. O mesmo, segundo ele, poderia ser feito contra publicações que façam apologia do nazismo e sejam antidemocráticas, por exemplo.

"Por que pedofilia, pornografia infantil e direitos autorais, 93% do que é publicado, as redes sociais retiram antes de ter um like, uma visualização? Porque elas podem ser responsabilizadas. Aí é o bom uso da inteligência artificial. Elas conseguem retirar 93% antes de uma visualização. Os outros 7%, que ficam na dúvida, levam para uma comissão de seres humanos e [lá eles] retiram em uma, duas horas", explicou.

Moraes lembrou ainda que a regulamentação das bigh techs, ao contrário do que tem dito o bilionário Elon Musk, proprietário do X, antigo Twitter, passa longe de ser censura, mas, sim, uma forma de fazer com que as empresas assumam as mesmas responsabilidades que televisões e rádios já têm no Brasil.

Fake news nas eleições

Moraes ainda chamou a atenção para o perigo do uso das fake news durante o processo eleitoral, fato que pode alterar o resultado de uma eleição e, portanto, comprometer a democracia.

"O grande desafio hoje, do processo eleitoral, é garantir que cada um dos eleitores e cada uma das eleitoras não sejam bombardeados por notícias fraudulentas que pretendem desvirtuar a vontade do eleitor, a vontade da eleitora, na hora de depositar o seu voto. Como uma verdadeira lavagem cerebral com discursos de ódio, discursos misóginos, discursos homofóbicos, discursos antidemocráticos", destacou.

"E como se garantir isso? Voltando à ideia do início do século passado, muito consagrada pelo justice [jurista] Holmes: um mercado livre de ideias, não um mercado livre de mentiras, não um mercado livre de agressões, não um mercado livre de ódio, de nazismo, de fascismo", disse ainda.

Com informações da coluna de Mônica Bergamo