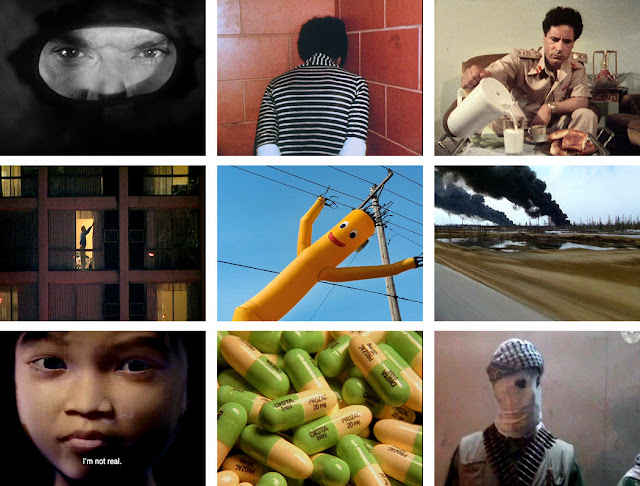

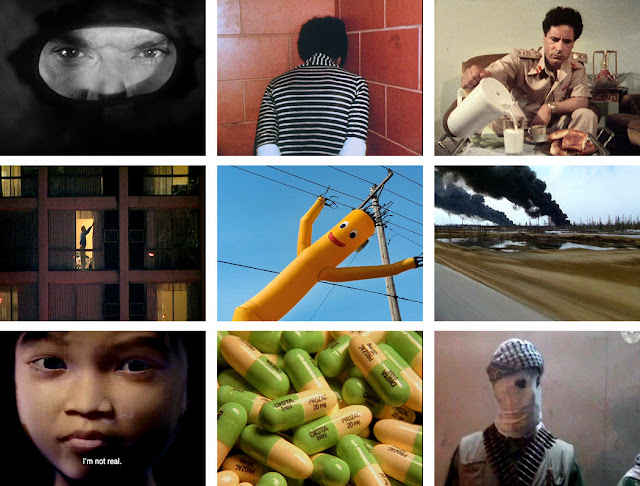

Certo dia um cientista do MIT criou um “computador terapeuta” chamado Eliza. Na verdade uma brincadeira, uma parodia sobre as tentativas frustradas em fazer uma Inteligência Artificial. As pessoas digitavam o que estavam sentindo e Eliza repetia a última frase, reformulando como fosse uma pergunta. Os “pacientes” começaram a levar à sério, passando horas diante de Eliza digitando seus problemas, desejos e motivações mais íntimas. Uma brincadeira que, sem querer, criou o paradigma que reformularia toda o conceito de Inteligência Artificial e abriria o campo dos algoritmos que controlam as atuais redes sociais e mecanismos de busca na Internet. Essa é uma das histórias do documentário “HyperNormalisation” (2016) de Adam Curtis. Analisado pelo “Cinegnose” em postagem anterior, vamos agora destacar como a fuga das pessoas para o ciberespaço, para escapar das complexidadse do mundo real, criou um outro aspecto da “HiperNormalização”: a Inteligência Artificial como um espelho individualista feito para criar a falsa sensação de estabilidade e segurança. Mas, às vezes, aspectos do “deserto do real” invadem essa bolha virtual.

Em postagem anterior discutíamos o novo documentário do britânico Adam Curtis chamado

HyperNormalisation (2016), transmitido em nove episódios pela BBC -

clique aqui. O documentário discute como a crescente aversão não só à Política, mas à própria complexidade dos problemas reais fez nos últimos 40 anos os indivíduos se retraírem no ciberespaço, Internet, redes sociais como uma bolha ou espelho de si mesmos.

Mais além, como financistas, utopistas tecnológicos e políticos criaram, através da mídia e gestão da percepção, uma versão simplificada do mundo real: a “HiperNormalização”. E o que é pior, de como os próprias lideranças políticas acabaram acreditando nessa narrativa ficcional (muitas vezes inspirada em roteiros de filmes hollywoodianos), tornando tênues as fronteiras entre realidade e ficção. Uma versão não só simplificada do mundo, como também conciliadora – enquanto as pessoas têm corações e mentes capturadas por essas narrativas, grandes corporações e o mundo das finanças continuam gerindo tranquilamente o equilíbrio sistêmico do “deserto do real”.

Dando continuidade a essa discussão, nessa postagem vamos discutir como o documentário

HyperNormalisation aborda o ciberespaço e Internet como partes decisivas nesse movimento generalizado de abandono do mundo real.

Maçãs e gestão de riscos

Esse abandono foi impulsionado pelo desejo por estabilidade e segurança. O documentário relata o exemplo do computador Alladin da empresa de gestão de riscos BlackRock, na pequena cidade chamada East Wenatchee, no Estado de Washington. Entre pomares, Larry Fink construiu no final dos anos 1990 uma empresa de gestão de riscos baseada em um gigantesco computador, o Alladin, alojado em uma série de grandes galpões usados para armazenar maçãs.

O objetivo era o computador prever com certeza o risco de qualquer negócio ou investimento, monitorando todos os tipos de eventos mundiais e comparando-os com dados dos últimos 50 anos. Em seguida o computador detecta possíveis desastres no futuro.

Os algoritmos do software do BlackRock são tão bem sucedidos (manipula 7% dos ativos financeiros mundiais) que atualmente o Federal Reserve estuda se Alladin não deve ser promovido à condição de “SIFI”(Instituição Financeira Sistemicamente Importante) sob direta supervisão governamental.

Adam Curtis cita esse exemplo de como o conceito de Inteligência Artificial desenvolvido nos anos 1960-70 transformou-se no desenvolvimento de algoritmos capazes de transformar Big Data das redes que estabiliza tanto o “deserto do real” da economia quanto o ego dos indivíduos que abandonaram esse “deserto” e se protegeram no ciberespaço. Uma espécie de Prozac informático.

HyperNormalisation mostra como nos anos 1960 havia um otimismo generalizado entre utopistas tecnológicos de que os computadores um dia poderiam pensar como seres humanos. Passaram anos tentando programas as regras que comandam o pensamento humano. Mas sem sucesso.

A “psicoterapeuta” Eliza

Até que um dia nos anos 1980, um cientista da computação do MIT chamado Joseph Wisembaum ficou tão desiludido que resolveu fazer uma parodia desse fracasso dizendo para todos que tinha feito um computador terapeuta: simplesmente as pessoas poderiam digitar os seus problemas que o programa chamado Eliza daria as respostas para o “paciente”. Uma brincadeira que, sem querer, fez Wisembaum tropeçar no paradigma que reformularia toda o conceito de Inteligência Artificial e abriria o campo dos algoritmos que governam as redes sociais e mecanismos de busca na Internet.

O “paciente” sentava na frente da tela e digitava o que estava sentindo. Eliza simplesmente repetia a última coisa que o usuário havia dito, reformulando sob a forma de pergunta. Wisembaum descobriu que todos que usam o Eliza ficavam absorvidos pelo programa: sentavam horas dizendo para a máquina seus sentimentos mais íntimos e incríveis detalhes da vida pessoal.

“O computador não te olha feio, não se irrita e nem tenta transar com você!”, confessou uma usuária. Para Curtis, o que o Eliza exprimiu foi a era do individualismo, que faz as pessoas se sentirem seguras ao verem sua personalidade refletida, como um espelho.

O que lembra um outro episódio, dessa vez na Universidade de Stanford: o desenvolvimento das técnicas de pesquisa em Marketing dos Valores e Estilo de Vida (VALS) no anos 1980, no qual foram enviados formulários de perguntas para consumidores via correio. O retorno foi surpreendente (86%). As pessoas perguntavam: “vocês têm outros questionários para eu preencher?”. As pessoas simplesmente adoraram falar de si mesmas, confessando seus desejos, incertezas, pensamentos e motivações.

Novo conceito de Inteligência Artificial

Hoje a Internet e redes sociais são desdobramentos em escala gigantesca do

insight possibilitado pelo programa “Eliza”. É o novo conceito de Inteligência Artificial: os agentes inteligentes – algoritmos de grandes corporações que monitoram o

Big Data para criar correlações e padrões para prever o que as pessoas irão querer no futuro.

>>>>>Continue lendo no Cinegnose>>>>>>>